Grad-CAM: Visual Explanations from Deep Networks via Gradient-based Localization

中文名:梯度加权的类激活图

produce a coarse localization map highlighting the important regions in the image for predicting the concept

主要工作

- Grad-CAM应用到:图像分类、图像描述、VQA问题中

- 判断哪些神经元是重要的(use neuron importance from Grad-CAM and obtain textual explanations)

- Guide Grad-CAM

背景

先前的CAM只能使用最后为GAP的CNN,不能适用含有fc层(VGG)、结构输出(caption)、多输入(VQA)、强化学习还有without architectural changes or re-training等类型的模型

对于可解释模型的观点:

- 当AI弱于人类时,通过解释识别错误模式,帮助研究者进行更深入地分析

- 当AI与人类能力相近时,可解释模型能提升模型的可信度

- 当AI强于人类时,可解释模型能教人类如何做更好的决策

分类任務中Grad-CAM用途

- 对分类错误的图片进行可视化

- 作为弱监督检测,效果不错

- 对于对抗扰动具有一定的鲁棒性

- 提升了模型的可信度

- 通过识别数据集偏差帮助实现模型泛化

对于VQA、Image Caption问题,提供了一个不用注意力模型的弱监督方法

相关工作

Guided Backpropagation [53] and Deconvolution [57]这两个方法能做到高分辨率、细粒度的可视化,但是不具有类可判别的能力

CNN可视化(这些方法的共同缺点是都不具有类可判别性)

Deep inside convolutional networks: Visualising image classification models and saliency maps.

可视化预测分数的偏导

Striving for Simplicity: The All Convolutional Net

Guided Backpropagation

Visualizing and understanding convolutional networks

Deconvolution

Devnet: A deep event network for multimedia event detection and evidence recounting

Salient deconvolutional networks 这篇论文对前面的一系列工作做了比较

此外还有一些方法如:最大激活网络单元、隐空间转换这些方法不是对图像的可视化,而是对模型进行可视化

模型可信度评估

弱监督检测(任务描述:只是用图像中对象的类别标签学习对象定位问题)

- CAM

- GAP、log-sum-exp pooling

其他方法

- 通过遮挡斑块等干扰输入方法看哪些区域对于目标类别有较大影响(Grad-CAM相比于这些方法来说更简洁“one shot”)

w.r.t. : with respect to

关于;谈及,谈到

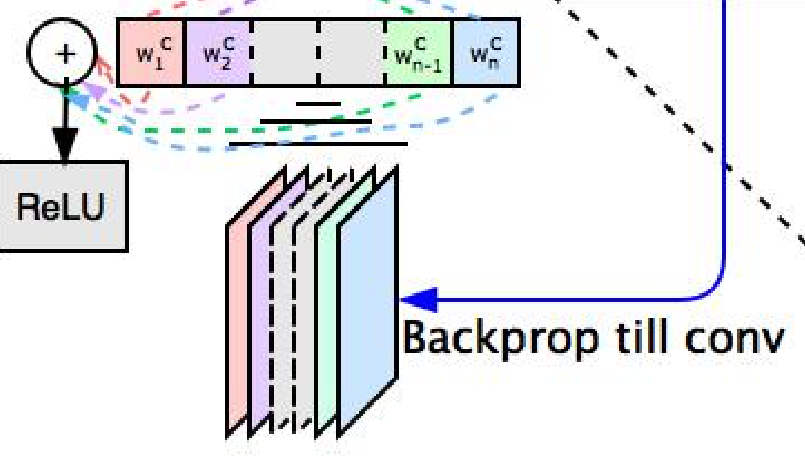

Grad-CAM & Guided Grad-CAM

class-discriminative localization map

反向传播得到的特征图进行求和,然后和前向运算的结果进行加权求和,最后过一个ReLU得到Grad-CAM

Guided Grad-CAM是Grad-CAM与Guided Backprop进行逐元素乘得到的结果

权重计算的数学形式

Grad-CAM的数学形式

Q&A

使用ReLU的原因

we are only interested in the features that have a positive influence on the class of interest

without this ReLU, localization maps sometimes highlight more than just the desired class and perform worse at localization(后面有消融实验解释了这一点)

为什么不用低层的卷积层做Grad-CAM?

We find that Grad-CAM maps become progressively worse as we

move to earlier convolutional layers as they have smaller receptive fields and only focus on less semantic local features.

为什么梯度求和的Grad-CAM是CAM方法的泛化?

推导发现GAP时,梯度求和结果与权重相等

Guided Grad-CAM有什么用途

Grad-CAM在算完location map后,需要resize到224x224,但是这样相当于location map的分辨率停留在14x14,因此,有必要用Guided Grad-CAM进行更高分辨率的解释

Evluation

实验做的很多,有定性的有定量的,但是没什么信息量。

弱监督检测与分割任务

消融实验

没有最后的ReLU,error涨了15个点